Sinn und Irrsinn

Im Zuge der Digitalisierung wird die Realität zunehmend mit Zeichensystemen verwechselt, die diese nur abzubilden versuchen.

Die meisten Medienmitteilungen über künstliche Intelligenz sind sich einig: Die KI wird sich mit der Zeit selbsttätig immer weiter verbessern und den Menschen in immer mehr Bereichen überflügeln. Aber ist das wirklich so? Wir verfügen ja bisher noch nicht über lange Erfahrung mit dem neuen „Spielzeug“. Mit zunehmender Laufzeit dürfte sich künstliche Intelligenz immer mehr mit ihren eigenen Erzeugnissen beschäftigen, wird selbstbezüglich und verliert so den Kontakt zu jener Realität, die sie ursprünglich nur abbilden oder verarbeiten sollte. Wir erhalten Plagiate von Plagiaten, künstliche Imitate von Künstlichem, Gehirnsalat, der sich auf anderen Gehirnsalat bezieht. Tendenzen, dass die Entwicklung in diese Richtung gehen könnte, sind bereits zu erkennen. Der Autor beruhigt erst einmal alle Menschen, die Angst davor haben, demnächst überflüssig zu werden. Und er gibt einen Hinweis, wie die KI daran gehindert werden kann, sich zunehmend von der Realität zu entfernen: Ab und zu muss man dort ein bisschen von der wirklichen Welt einspeisen.

Die Karte ist nicht das Territorium. Dieser Satz ist in manchen Kreisen beinahe schon zur Floskel geworden. Dennoch ist die Karte nicht gänzlich vom Territorium getrennt. Selbst die verzerrteste Karte hat ihren Ursprung.

In der algebraischen Topologie gibt es ein berühmtes Theorem, den Brouwer’schen Fixpunktsatz. Dieser besagt, dass bei jeder stetigen Abbildung einer geschlossenen Kugel auf sich selbst mindestens ein Punkt vorhanden ist, für den gilt: f(x)=x. Das heißt, ein Punkt bleibt unverändert. Das wiederum bedeutet, wenn du zwei Kopien eines Gemäldes hast und eines davon zerknüllst und über dem anderen platzierst, wird sich wenigstens ein Pixel direkt über seinem Zwilling befinden.

Die konzeptuellen Landkarten und Geschichten, in denen wir die Welt sehen, beginnen außerhalb von Konzepten: in der Sinneswahrnehmung und in verkörpertem Erfahren. Die Ideen, die ein Kind entwickelt, werden immer wieder an der Realität überprüft. Mit zunehmendem Alter handeln moderne Menschen immer mehr in einer Welt der Abstraktionen, Symbole, Konzepte und Darstellungen.

Die moderne Gesellschaft, die vermehrt in eine digitale Welt eingebunden ist, die nur noch Symbol ist, neigt in besonderer Weise dazu, sich in verwirrenden Illusionen, umfassenden Narrativen und Weltsichten zu verlieren, die kaum noch mit etwas Wirklichem verbunden sind — vielleicht nur noch über einen einzelnen Brouwer’schen Fixpunkt.

Die innere Logik einer Karte oder eines Glaubenssystems ist keine Garantie für deren Sinnhaftigkeit, wie dir eine Begegnung mit einem Anhänger der Flat-Earth-Theorie oder von QAnon bestätigen wird. Ihre Weltsichten sind in sich zum Verrücktwerden schlüssig.

Nicht nur die, die ich ganz einfach als irre Verschwörungstheoretiker abstempeln könnte, bewegen sich auf einer verzerrten Landkarte. Die typischen Glaubenssätze der Gesellschaft haben sich ebenso weit von der Wirklichkeit entfernt.

Neuere Erkenntnisse zu KI, die auf der Basis eines Large Language Model (LLM) Inhalte generiert, verdeutlichen die allgemeinere Entwicklung der Gesellschaft innerhalb der letzten hundert Jahre.

Anstatt uns endlich in die Lage zu versetzen, die Flut digitaler Daten in sinnvollere Strukturen zu bringen, droht die gegenwärtige Revolution in der KI ein ganz neues Level an Unsinn zu erschaffen. In einer kürzlichen Veröffentlichung argumentieren Forschende der Universitäten Stanford und Rice wie folgt: Je mehr KIs mit synthetischen, KI-generierten Daten trainieren, desto mehr verlieren die von ihnen generierten Ergebnisse an Qualität, Diversität oder beidem. Anders ausgedrückt: Die Bilder, die sie erzeugen, weichen zunehmend von echt wirkenden Bildern ab und ihre Vielfalt weicht einer immer größeren Gleichheit. Die Forscher nennen diesen Prozess eine „autophage Schleife“, in der die KI sich selbst verzehrt und wahnsinnig wird:

In der Sprache der Mathematik ist eine autophage Schleife — im einen Extrem — eine Kontraktion, die in einen einzelnen, langweiligen Punkt kollabiert, während sie — im anderen Extrem — eine instabile positive Feedbackschleife darstellt, die sich ins Chaos auseinanderentwickelt.

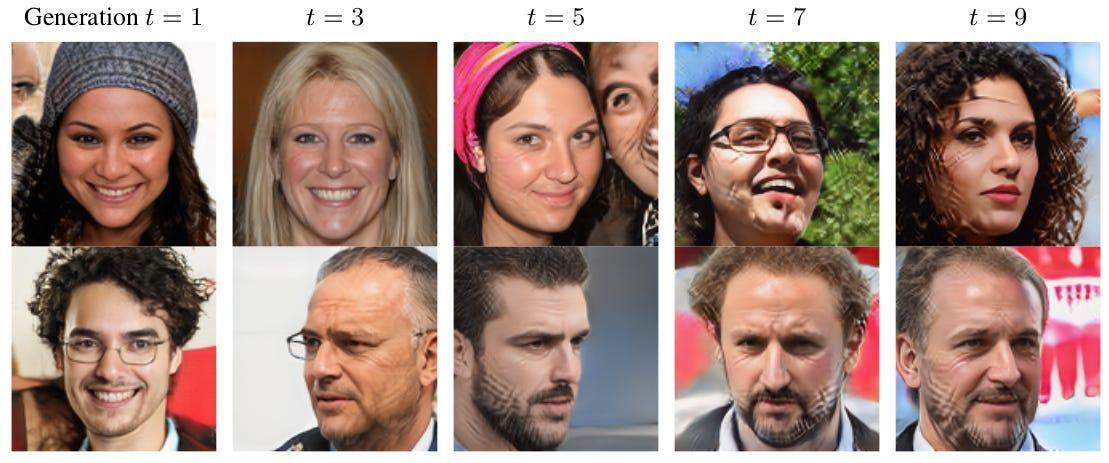

Homogenität oder Chaos. Das sind die Endpunkte eines komplexen Systems, das von neuen Impulsen abgeschnitten ist. Der Artikel zeigt Beispiele von Bildern, die durch iterative Modelle generiert wurden, die an ihren eigenen synthetischen Bildern trainiert werden. Bildfehler werden vergrößert, die Diversität geht zurück und seltsame Verzerrungen entwickeln sich, die normativ werden, da auch sie Teil der Trainingsdaten werden. Man würde annehmen, die LLM würden mit jedem Trainingsdurchlauf besser, aber das Gegenteil ist der Fall. Die generierten Gesichter werden immer schlechter. Beachte die Schraffur auf den Bildern der späteren Generation.

Bild von Alemohammad et al

Die Forschenden argumentieren, dass dies auch außerhalb ihrer Experimente leicht passieren könnte. Schließlich wird das Internet, aus dem LLM ihre Trainingsdaten ziehen, zunehmend durch synthetische Texte und Bilder besiedelt. Bald ist es so weit, dass mehr — möglicherweise viel mehr — synthetische Daten im Internet verfügbar sind als echte (von Menschen generierte) Daten. Mehr Fake-Bilder als echte Bilder. Mehr LLM-generierter Text als von Menschen geschriebener Text.

Das absurde Ergebnis könnte sein, dass die KI-Technologie, die menschliche Kreationen (Sprache, Bilder, Verhalten) imitieren und menschliche Gesichter generieren soll, immer schlechter wird, je mehr sie genutzt wird. Der einzige Weg, dies zu verhindern, liegt den Forschenden zufolge in der ständigen Ergänzung der Trainingsdaten mit ausreichenden Mengen an neuen Daten aus der echten Welt.

Wir Menschen bemerken bereits eine Art Trivialität in synthetischer Kunst. Sie wirkt abgekupfert. KI-generierte Poesie kann unterhaltsam sein, sogar gewitzt, aber niemand würde sie als inspiriert bezeichnen. Von ChatGPT geschriebene Artikel sind von einer verräterisch simplen Qualität, die wir schnell zu erkennen lernen.

Das alles würde noch mehr Aufsehen erregen, wenn nicht die von Menschen geschaffene Kunst und Literatur in dieselbe Richtung gingen. Der Abstieg in „Einheitsbrei, Irrsinn oder beides“ hat bereits lange vor der KI eingesetzt. KI erweitert, verankert und normalisiert die bereits degenerierende Produktion von Kulturgütern, die sie als Lernmodell nutzt. Die Gesellschaft als Ganzes ist einem ähnlichen Weg gefolgt wie die autophage KI, indem sie unaufhörlich dieselben abgenutzten Elemente ihres kulturellen Vermächtnisses in immer verschlungeneren Labyrinthen von Selbstreferenzialität verschlingt und wieder ausspuckt.

Es scheint so, als würde das Trainingsdatenmaterial der kulturellen Vorstellungswelt mangels neuer Impulse ersticken. Menschen erschaffen im Internet neue Memes aus anderen Memes über Darstellungen von Darstellungen von Darstellungen von etwas, das einst real war. Wir machen Filme über Spielzeuge basierend auf Filmen basierend auf Comic-Büchern, die ursprünglich von einer authentischen Kreativität außerhalb des symbolischen Bereichs hervorgebracht wurden.

Da wir einen großen Teil unseres Zugangs dazu verloren haben, kannibalisieren wir stattdessen unser kulturelles Erbe. Die digitale Landkarte der Wirklichkeit ist dermaßen zusammengeknüllt und zerrissen, dass es schwierig ist, den Brouwer’schen Fixpunkt zu finden, der sie an etwas Reales bindet (1). Nicht einmal Guy Debord hätte sich ausmalen können, dass die Gesellschaft sich so ganz und gar in ihrem Spektakel hat verlieren können.

KI ist lediglich die Kulmination einer langen Reise von der Realität zur Darstellung, vom Sinn zum Symbol. Sie beschleunigt einen Prozess, der vor langer Zeit begonnen hat: die Involution der modernen Kultur, die ihren Kontakt zur Quelle verloren hat und sich um sich selbst dreht, und damit zu Einheitsbrei und Irrsinn verkommt.

Wie oben, so unten. Ich habe bemerkt, dass es in meinem eigenen Kopf nicht anders abläuft. Ich kann mich in einem Irrgarten aus Ideen von Ideen verlieren, die in vollkommen in sich schlüssigen, aber objektiv verrückten Trugbildern münden. Dieser Vorgang kann allein durch den Zufluss einer Vielzahl an neuen Informationen von außerhalb meiner inneren LLM-Trainingsdaten umgekehrt werden.

Das heißt, ich muss mich wieder mit dem protokonzeptuellen Meer an Informationen aus Sinneswahrnehmung, Geist, Körper und Atmung verbinden. Tue ich das nicht, so werde ich bald so verrückt wie unsere Gesellschaft, und die Welt, die ich durch meine kognitiven Filter sehe, degeneriert zu einem wahnsinnigen Chaos oder einer vulgären Gleichheit. Entweder ergibt nichts mehr einen Sinn, oder jede Idee erscheint trivial, ausgelutscht und sekundär. Es ist ein spirituelles Ersticken, das mich in einer Hölle der Endlichkeit gefangen hält.

(Wer darauf hofft, sein Bewusstsein in ein neuronales Netz hochzuladen, den erwartet eine böse Überraschung, wenn er — Gott bewahre — damit Erfolg haben sollte. Sein ist nicht gleichbedeutend mit Berechnen. Die Wirklichkeit ist nicht auf Daten zu reduzieren. Die Schöpfung ist nicht endlich. Aber er wird sich in ein endliches Gefängnis eingesperrt haben, dem er nicht entfliehen kann. Er wird um die verlorenen Dimensionen unendlichen, beziehungsvollen Seins trauern.)

Zu einem gewissen Grad spürt ein Großteil der modernen Gesellschaft diese Sehnsucht danach, aus der Homogenität und/oder dem Unsinn eines Glaubenssystems auszubrechen, das an fehlender Belüftung in Form von gelebter Erfahrung zu ersticken droht.

Ist der vorliegende Essay ein Beispiel dafür? Um Debord zu paraphrasieren: Jede Kritik am Spektakel wird zum Teil des Spektakels. Oder wie Philip K. Dick sagte: „Das Imperium zu bekämpfen bedeutet mit dessen Geistesstörung infiziert zu werden.“ Ich hoffe, wer das hier liest, wird bestätigen können, dass dieser Essay keine bloße Neuzusammensetzung der Elemente ist, die auch ein LLM leisten könnte. Ohne den heutigen Input durch den Ozean hätte ich das nicht schreiben können. Wie jeder wahre Künstler bin ich ein Gefäß für den andauernden Schaffensprozess. Etwas Neues erscheint, nicht von mir, sondern durch mich. Wenn ich in meinem Büro sitze und nachdenke, und dabei nur aus den realen Altdaten und den aus ihnen generierten synthetischen Daten schöpfe, ohne neue Daten von außen hinzuzufügen, kann ich nichts tun als die Einzelteile neu zusammenzufügen.

Das ist es, was LLMs tun. Sie fügen die Einzelteile neu zusammen. Damit erreichen sie eine Menge. Sie sind viel besser darin, Teile neu zusammenzusetzen, als Menschen. Wäre der Mensch das Gehirn und wäre das Gehirn wirklich ein wasserdichtes Teilesortiersystem, dann gäbe es nichts, was ein Mensch sagen oder denken könnte, das ein Computer nicht auch könnte.

Heute erleben wir einen steilen Anstieg der Entwicklung der künstlichen Intelligenz. In unserem Erfolgstaumel sind die Grenzen der KI nicht leicht zu erkennen. Ihre Gefahren sind offensichtlich, aber ihre Begrenztheit rückt erst jetzt ins Blickfeld. Die Seelenlosigkeit von synthetischer Kunst lässt einen Aspekt dieser Begrenztheit aufscheinen. Was verleiht der Kunst eine Seele oder der Poesie Inspiration? Dies sind dynamische, relationale Eigenschaften. Die Mona Lisa war ein wunderbar beseeltes Gemälde. Ihre endlose Reproduktion ist es nicht.

Die KI-erzeugten Imitationen der Kunst zweiten oder dritten Grades kopieren nicht nur Bilder, die Menschen kreiert haben; sie kopieren und kombinieren stilistische Elemente, Prinzipien und Themen. Natürlich machen das auch Menschen, aber wir sind nicht darauf begrenzt. Ein wahrer Schöpfer fügt dem, was vorher da war, etwas Neues hinzu. Kultur setzt sich nicht einfach immer wieder neu zusammen. Sie bezieht Neues von außerhalb ihrer Selbst mit ein. Kulturen, die dieses Neue ausschließen, verkümmern und degenerieren ebenso, wie es die Bilder der Forschenden taten — zu Einheitsbrei oder Irrsinn.

Die Informationstechnologie hat uns zu Meistern des Quantitativen werden lassen. Quantitative Daten erstellen eine Karte der Welt, die Menschen und Dinge, Worte und Bewegungen, Gesichter und Stimmen, Orte und Momente mit Zahlen repräsentiert.

Mit unserer zunehmenden Fähigkeit, messbare Größen zu extrahieren und Objekte zu klassifizieren, ist auch die Überzeugung gewachsen, dass die Welt aus messbaren Größen besteht. Dementsprechend verbannen wir das Qualitative, das Analoge und das Nicht-Repräsentative aus unserer Betrachtung und ersticken die Quelle neuer Informationen, die Geist und Kultur lebendig erhalten, im Keim.

Wir Menschen werden und sollten nicht aufhören, Karten zu zeichnen. Wir werden und sollten nicht die Werkzeuge der Repräsentation und Quantifizierung abschaffen. Aber wir müssen ihre Begrenztheit erkennen. Informationen sind mehr als nur Daten, und Intelligenz ist mehr als Berechnung. Wir, die die KI-Werkzeuge steuern, müssen außerhalb der autophagen Schleife bleiben; unser Lernen muss sich anderer Quellen bedienen als der Produkte dieser Werkzeuge. Wir dürfen uns nicht auf KI-Berechnungen verlassen, um uns Dinge zu erschließen. Wir müssen uns — als Individuen und in sozialen und politischen Prozessen — weiter für Informationen öffnen, die nicht in Zahlen und Kennzeichen, in Pixel und Bits verpackt werden können.

Gibt es solche Informationen überhaupt? Eine Säule der wissenschaftlich-metaphysischen Ideologie ist, dass alles messbar ist. Von innerhalb der digitalen Matrix sieht es genau danach aus. Wenn ich einen Windhauch in meinem Gesicht spüre und Erde unter meinen Füßen, wenn ich einen Kolibri in den Hortensien umherschwirren sehe, wenn ich mich in den Meeresfluten tummle oder bei einem Bienenstich vor Schmerz japse, weiß ich, dass es anders ist. Wir können die digitale Welt gesund halten, indem wir aus der Welt außerhalb von ihr schöpfen.

Redaktionelle Anmerkung: Dieser Beitrag erschien zuerst unter dem Titel „From Homogeneity and Bedlam to Sense and Sensibility“ auf dem Blog von Charles Eistenstein. Er wurde von Vanessa Groß ins Deutsche übersetzt, anschließend von Ingrid Suprayan und Bobby Langer korrekturgelesen und unter dem Titel „Von Einheitsbrei und Irrsinn zu Sinn und Verstand“ beim deutschen Ableger des Blogs veröffentlicht. Die Audioversion wurde von Marcus Jurk gelesen.

Quellen und Anmerkungen:

(1) Für die Mathe-Freaks unter euch: Wenn die Karte tatsächlich zerrissen ist, dann gilt das Brouwer‘sche Fixpunktheorem nicht mehr, weil es die Bedingung der stetigen Funktion nicht mehr erfüllt. Ich habe darüber nachgedacht, die Metapher derart auszuweiten, dass diese Idee miteinbezogen werden kann, aber das hätte den Bogen überspannt. (Spannen und ziehen ist allerdings erlaubt, haha. Solange der Bereich homöomorph zur geschlossenen Kugel ist, gilt das Theorem.)